Série Criando um Chatbot com IA e n8n - Artigo 1: Introdução ao n8n para Automações com IA

Com a popularização das APIs de Inteligência Artificial como OpenAI, HuggingFace, Gemini e modelos locais como o Ollama, o n8n se tornou um playground incrível para construir soluções baseadas em IA – como chatbots, agentes autônomos, resumos automáticos, classificações e muito mais.

Série Criando um Chatbot com IA e n8n - Artigo 1.

Como criar fluxos inteligentes com LLMs sem sair do n8n.

Visão Geral

O n8n é uma ferramenta poderosa de automação que permite integrar APIs, manipular dados e orquestrar fluxos complexos sem precisar escrever muito código.

Com a popularização das APIs de Inteligência Artificial como OpenAI, HuggingFace, Gemini e modelos locais como o Ollama, o n8n se tornou um playground incrível para construir soluções baseadas em IA – como chatbots, agentes autônomos, resumos automáticos, classificações e muito mais.

Neste artigo, você vai aprender:

- O que é o n8n e por que ele é ideal para automações com IA.

- Como criar seu primeiro fluxo com OpenAI para processar mensagens.

- Como medir o tempo de resposta e latência da IA.

O que é o n8n?

O n8n (pronuncia-se “n-eight-n”, “n-oito-n” no Brasil) é uma ferramenta de automação de código aberto que funciona como um "Zapier turbinado". Diferente de ferramentas tradicionais, ele permite:

- Executar JavaScript e Python customizado em qualquer ponto do fluxo.

- Fazer chamadas HTTP com autenticações complexas - aqui é o que o N8N ganha bastante na robustez da solução para sistemas interoperáveis.

- Controlar a lógica com condicionais, loops e branches.

- Salvar dados em bancos, planilhas, Notion, Airtable, etc. Há praticamente um conector para cada um dos grandes SaaS de mercado

Além disso, ele roda localmente, na nuvem self hosted ou na nuvem contratada (modelo SaaS), o que o torna ideal para diferentes níveis de conhecimento de equipe.

Nosso caso de uso: Responder Perguntas com IA

Vamos criar um fluxo que:

- Recebe uma pergunta via bloco de Chat.

- Envia a pergunta para a API da OpenAI.

- Loga o tempo de resposta da IA.

O que você precisará

Para conseguir executar esse artigo você precisará:

- Uma conta, com um API Token na Open AI

- Docker e Docker Compose instalado, para executar o N8N dentro de um container - ou uma conta no n8n free trial online (o n8n te dá 14 dias para testar o produto de graça)

Garanta que você possui credenciais válidas na Open AI e consegue executar workflows do n8n seja local seja em nuvem. Feito isso, vamos para o próximo passo.

Passo a Passo no n8n

1. Criando um Workflow

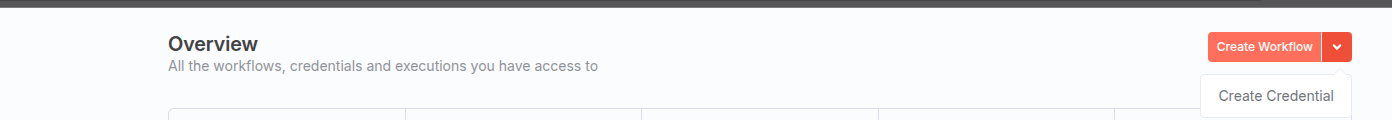

O N8N possui duas principais entidades: Workflows e Credenciais.

O Workflow nada mais é do que um fluxo de trabalho, uma tarefa. Você pode ter quantos workflows quiser, fazer um workflow chamar outro workflow, agrupá-los por tag e muito mais.

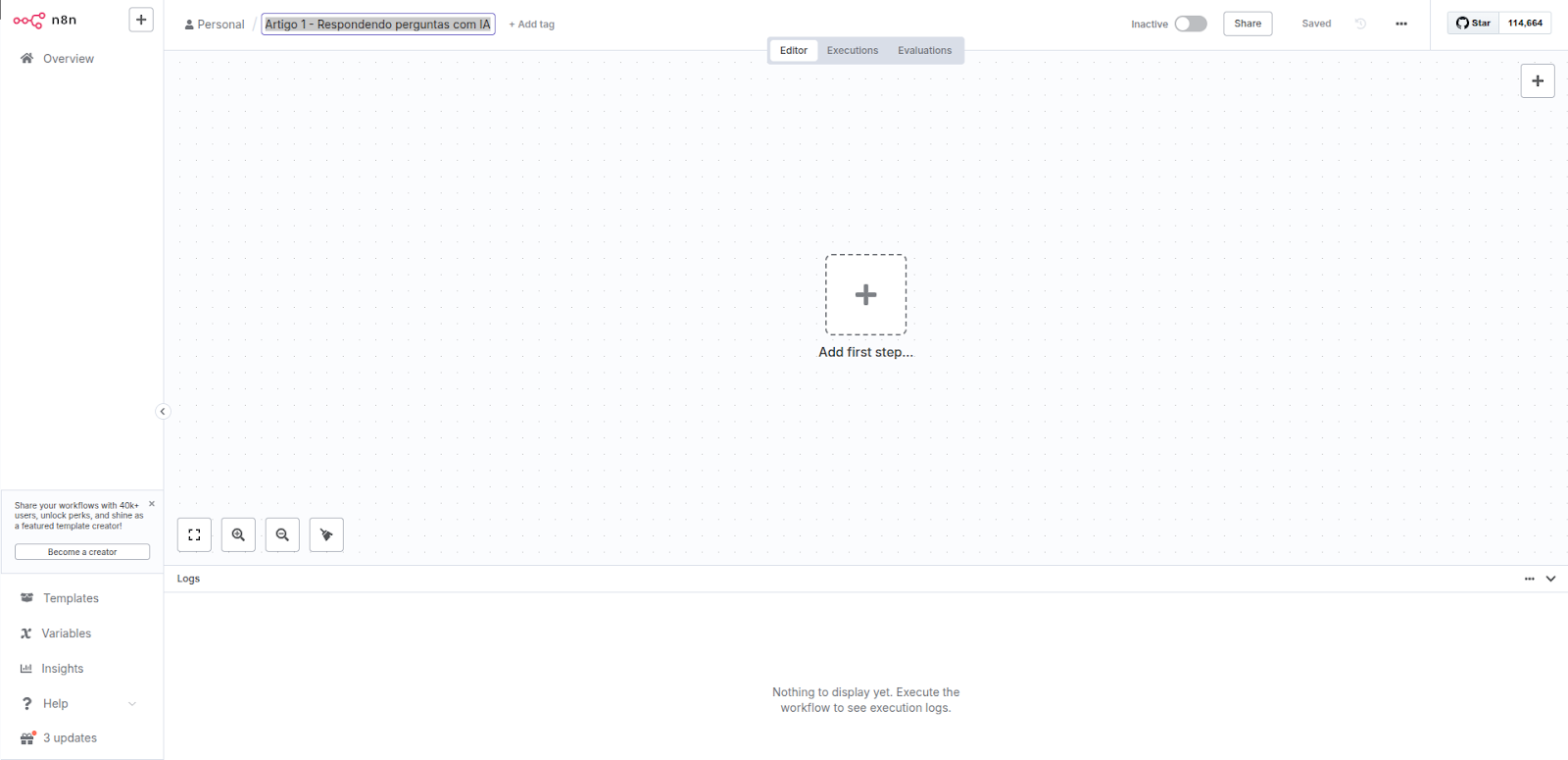

Os workflows são quem efetivamente executam os processos. Todo workflow, ao ser aberto, possui o editor e o seu histórico de execuções, extremamente útil para debug.

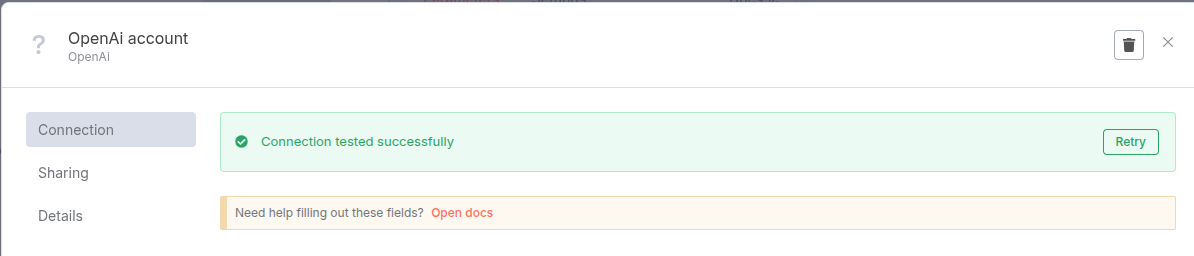

Uma credencial é um segredo que serve para conectar o seu workflow a sistemas externos. No N8N você pode usar credenciais pré definidas (ele possui conector a vários serviços) ou credenciais genéricas (como padrão OAuth), para se adequar a todos os casos.

Crie um workflow e renomeie ele! Aí podemos começar os trabalhos.

2. Adicionando nosso trigger

Clique para adicionar um primeiro item e adicione o “When chat message received”. O raio que aparece ao lado desse bloco indica que ele é um bloco de trigger - ou seja, capaz de iniciar a execução de um workflow.

Vá sempre salvando as alterações conforme for trabalhando no seu workflow.

3. Consultando a Open AI

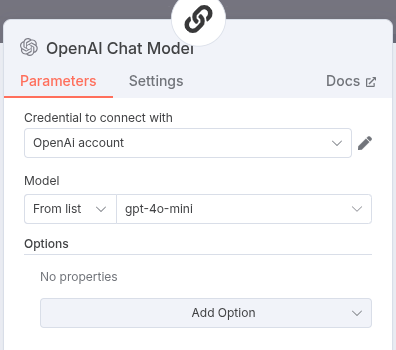

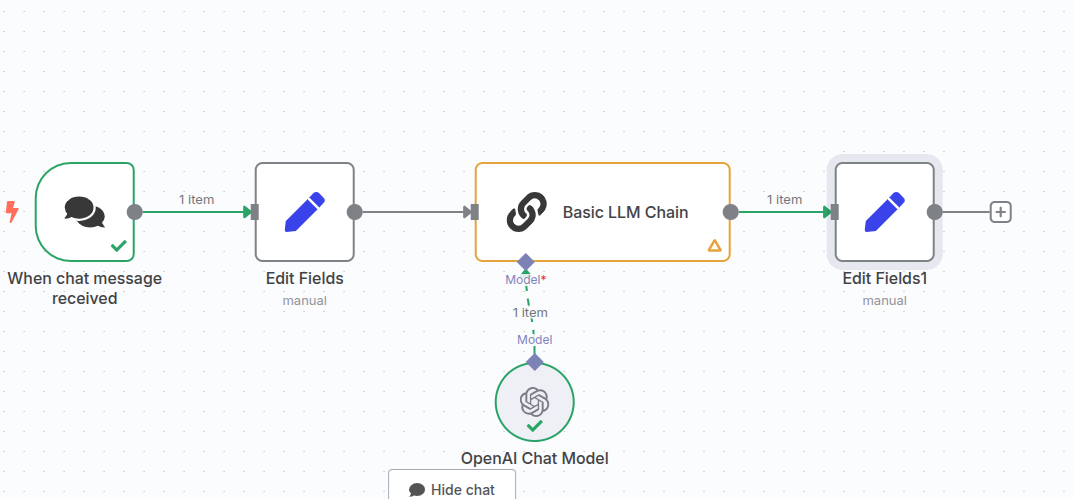

Selecione o bloco “Basic LLM Chain” e conecte ele à um modelo da Open AI. Para configurar o modelo será necessário criar uma nova Credencial.

Para qualquer dúvida de como acessar a sua chave de API, basta clicar no “Open Docs”. O N8N possui uma documentação bem robusta e tipicamente é só seguir um passo a passo para concluir a conexão.

Caso já não esteja selecionado, selecione o modelo gpt-4o-mini.

E é isso 🎉, está funcional! Você pode clicar no botão de test e usar a própria interface de testes do n8n para conversar um pouco e ver o seu bot funcionando.

4. Medindo o tempo de execução (opcional, mas interessante 😎)

Algo que nos preocupamos bastante ao executar um modelo de LLM é metrificar paramâmetros (modelo, inputs e outputs, tempo de execução, etc) e, posteriormente, montarmos análises para tomada de decisão.

Para capturar o tempo de execução podemos usar um pouco mais de configuração de N8N.

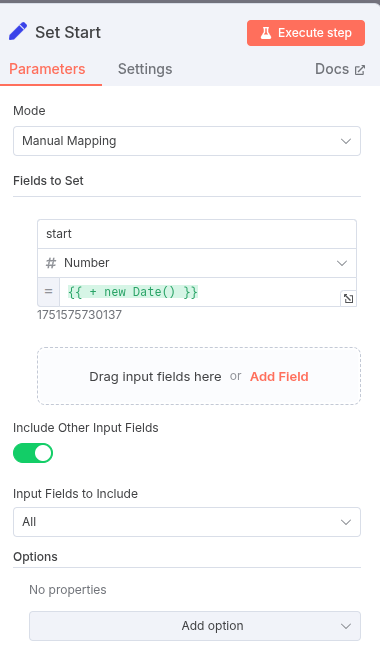

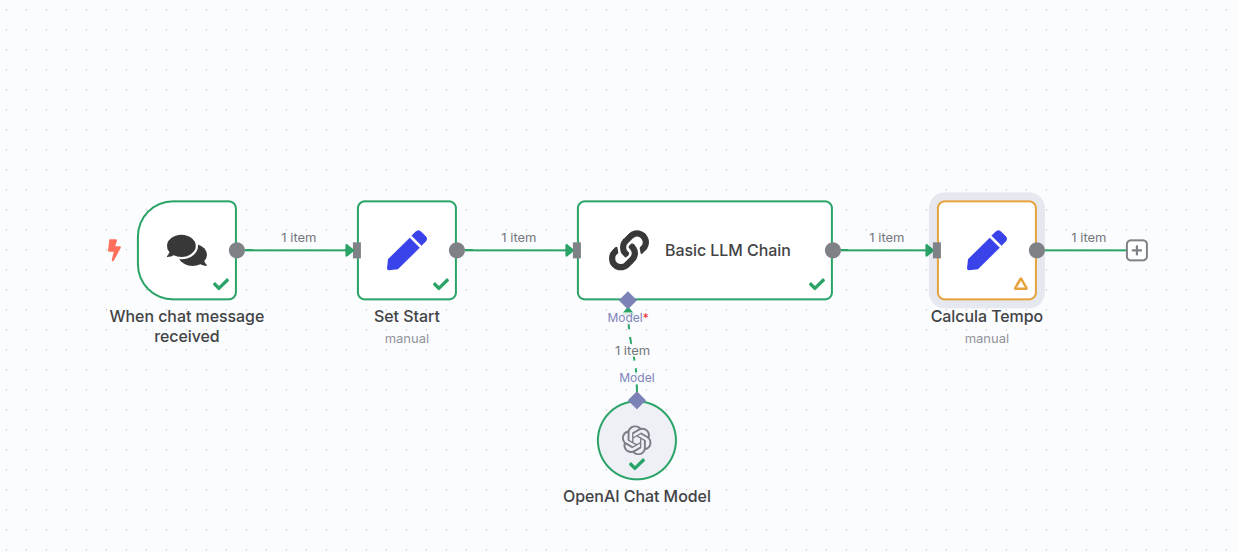

Para isso, antes de executar um workflow, adicione um bloco do tipo Set e adicione o mesmo na saída do modelo, ficando com algo assim:

No primeiro set iremos passar para frente todos os inputs mais o início do request para o modelo:

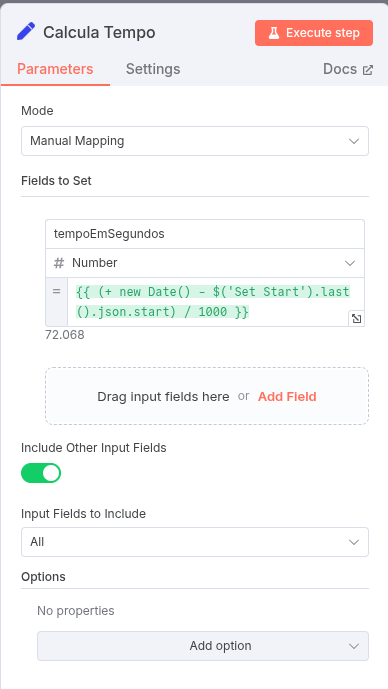

No segundo set, iremos calcular o tempo gasto, montando a seguinte expressão:

Aqui, você já explorou um potencial bem legal do N8N, que é o uso de expressões.

Cada bloco pode conter expressões ou textos em todos os parâmetros e, dentro de uma expressão você pode adicionar código Javascript e referenciar qualquer outro nó ou input.

E agora sim! Seu workflow está simples mas já completo, com pergunta, resposta, conectado a um modelo e ainda metrificando o tempo de execução do seu LLM.

Em um projeto esse tipo de parâmetro seria salvo antes de ser retornado ao usuário.

🔍 Backup do workflow

Você pode copiar e colar blocos do n8n com um simples CTRL C + CTRL V. Ao fazer esse processo você gera um arquivo JSON, sem as credenciais (ou seja, ‘seguro’ de ser compartilhável), mas com todo o fluxo do workflow.

Caso você queria, basta selecionar esse JSON no github a seguir e dar um CTRL V no seu workflow para resgatar ele completamente.

📦 Próximos passos da série

No próximo artigo, vamos: 👉 Criar uma base de conhecimento simples e fazer o chatbot responder com base nesses dados.

Comments ()